En los últimos años me han preguntado cada vez con más frecuencia si inventé el término «AGI» (Inteligencia General Artificial), y la respuesta es «¡no del todo!».

De hecho, soy el responsable de difundir el término por todo el mundo… ¡y de alguna manera encargué su creación! Pero en realidad no acuñé la frase…

(Sí, la terminología es, en última instancia, un tema bastante aburrido. Pero en la práctica, influye mucho más de lo que «debería»… Así que me resulta medianamente interesante observar cómo se origina y se difunde).

La historia, bastante discreta, es la siguiente. Alrededor de 2002, Cassio Pennachin (en la foto) y yo estábamos editando un libro sobre enfoques para una IA potente, con amplias capacidades a nivel humano y más allá, y nos costó encontrar un título. El título provisional era «IA Real», pero sabía que era demasiado controvertido. Así que envié un correo electrónico a un grupo de amigos pidiendo mejores sugerencias.

Shane Legg, (en la foto) un investigador de IA que había trabajado para mí anteriormente, propuso la Inteligencia Artificial General. No me gustó mucho, pero pronto llegué a la conclusión de que era mejor que cualquiera de las alternativas. Así que Cassio y yo usamos el término para el título del libro (el libro «Inteligencia General Artificial» fue publicado finalmente por Springer en 2005), y comencé a usarlo de forma más amplia.

Unos años más tarde, alguien me comentó que un investigador de Maryland llamado Mark Gubrud (en la foto) (quien, casualmente, trabaja cerca de donde vivo en Rockville, aunque no nos conocimos hasta que asistió a la Segunda Conferencia de IAG en 2010; esto es típico de Washington D. C.: hay muchísimas cosas interesantes en marcha, pero no tanta comunicación dentro de la comunidad científica e ingenieril como en otros lugares) había usado el término en un artículo de 1997 sobre el futuro de la tecnología y los riesgos asociados. Si conoces algún uso anterior, ¡házmelo saber!

En aquel entonces, Ray Kurzweil (en la foto) usó el término «IA fuerte» para (quizás no exactamente, pero bastante parecido) lo que ahora llamo IAG. Esto está bien, pero a Cassio y a mí nos pareció que tenía dos problemas.

En primer lugar, el antónimo de «IA fuerte» es «IA débil», y llamar «débiles» a los sistemas de IA existentes resulta innecesariamente insultante para sus creadores, así como para los propios sistemas de IA, ya que, por ejemplo, Deep Blue es un jugador de ajedrez bastante bueno. Kurzweil solucionó este problema usando «IA fuerte» e «IA limitada» como antónimos, pero nos pareció un uso poco óptimo. Creo que a Ray todavía le gusta el término «IA fuerte», pero ahora también se refiere a veces a «IAG».

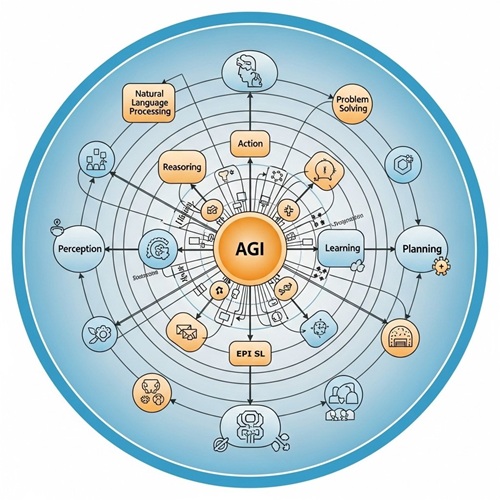

En segundo lugar, «IA fuerte» tiene un significado específico en la filosofía de la IA: se refiere a la hipótesis de John Searle (en la foto) de que, si un sistema inteligente se comporta como si tuviera mente, entonces deberíamos asumir que realmente la tiene. Los puntos fuertes del término «AGI» son su evidente conexión con el término reconocido «IA» y su conexión con el «factor g» de la inteligencia general, bien conocido en el campo de la psicología (es lo que se supone que miden los tests de CI). Sin embargo, también presenta algunos puntos débiles.

«Artificial» no es realmente apropiado, ya que la AGI no se trata solo de construir sistemas que sean nuestras herramientas o «artificios». ¡Supongo que se trata de usar artificios para construir inteligencias generales!

«General» es problemático, porque ninguna inteligencia del mundo real será jamás totalmente general. Todo sistema del mundo real tendrá algunas limitaciones y será mejor resolviendo algunos tipos de problemas que otros. (Aun así, por supuesto, algunos sistemas pueden tener una inteligencia más general que otros; en uno de mis artículos presentados en AGI-10, di una definición formal de «generalidad de la inteligencia» que la distingue de «grado de inteligencia»).

«Inteligencia», finalmente, es un término bastante mal definido, y salvo en contextos matemáticos muy abstractos, bastante alejados de los sistemas del mundo real, nadie tiene una idea totalmente clara de su significado. Shane Legg y Marcus Hutter (en la foto) escribieron en 2007 un artículo interesante que recopila más de 70 definiciones de inteligencia de diversas ramas de la literatura científica y de ingeniería.

Pero a pesar de estas deficiencias, el término «AGI» me gusta bastante. Parece estar teniendo bastante éxito, tanto en la comunidad científica como en los medios futuristas. ¡Larga vida a la AGI!

Ben Goertzel (en la foto) es un científico multidisciplinar, emprendedor y autor. Nacido en Brasil de padres estadounidenses, en 2020, tras una larga estancia en Hong Kong, trasladó su principal base de operaciones a la zona rural de Seattle. Dirige la Fundación SingularityNET, la Fundación OpenCog y la Sociedad AGI, que organiza la conferencia anual sobre Inteligencia Artificial General.

Goertzel también preside la organización futurista sin ánimo de lucro Humanity+ y es el científico jefe de las empresas de IA Singularity Studio, Rejuve, SingularityDAO y Xccelerando Media, todas ellas integrantes del ecosistema SingularityNET. Como científico jefe de la empresa de robótica Hanson Robotics, dirigió el equipo de software del robot Sophia; como científico jefe de IA de Awakening Health, lidera el equipo que desarrolla la mente detrás de Grace, la hermana pequeña de Sophia.

Fuente: https://twimlai.com/network/ben-goertzel